Trong cuộc cách mạng Modern Data Stack, nếu Data Lakehouse là “trái tim” của hệ thống dữ liệu hiện đại, thì các Open Table Format chính là “mạch máu” duy trì sự sống. Cuộc cạnh tranh giữa Delta Lake vs Iceberg vs Hudi không đơn thuần là sự so sánh giữa các thư viện mã nguồn mở, mà là cuộc chiến giành quyền định nghĩa cách thức dữ liệu được lưu trữ, quản lý và khai thác trên đám mây.

Việc lựa chọn sai Table Format ngay từ đầu có thể dẫn đến “cơn ác mộng” về hiệu suất và chi phí khi quy mô dữ liệu đạt ngưỡng Petabyte. Bài viết này sẽ phân tích sâu các khía cạnh kiến trúc, sự đánh đổi (trade-off) và đưa ra framework lựa chọn thực chiến nhất cho doanh nghiệp.

Mục lục

1. Tại sao Data Lake truyền thống không còn đủ sức gánh vác?

Để hiểu tại sao chúng ta cần Delta Lake, Iceberg hay Hudi, hãy nhìn lại lịch sử. Trước đây, Data Lake (HDFS, S3) chỉ đơn giản là một nơi chứa các tập tin (Parquet, Avro, CSV). Tuy nhiên, khi nhu cầu phân tích trở nên phức tạp, các hạn chế chết người bắt đầu xuất hiện:

- Sự thiếu hụt tính ACID: Trong các cơ sở dữ liệu truyền thống, tính ACID đảm bảo rằng nếu một giao dịch ghi bị lỗi, hệ thống sẽ quay lại trạng thái cũ. Ở Data Lake thô, nếu một job Spark đang ghi 100 file mà bị “crash” ở file thứ 50, hệ thống sẽ bị lỗi dữ liệu nghiêm trọng (Partial Write), khiến các báo cáo BI sau đó sai lệch hoàn toàn.

- Bài toán cập nhật và xóa (Upserts/Deletes): Với các quy định như GDPR hay CCPA, doanh nghiệp bắt buộc phải xóa dữ liệu cá nhân của khách hàng khi được yêu cầu. Trên Data Lake truyền thống, bạn phải đọc toàn bộ partition, tìm dòng cần xóa, ghi lại toàn bộ partition đó và xóa file cũ – một quy trình cực kỳ tốn kém và dễ gây lỗi.

- Nghẽn cổ chai Metadata: Khi số lượng file tăng lên hàng triệu, việc chỉ liệt kê danh sách file (list files) trong một thư mục S3 có thể mất hàng phút. Điều này khiến tốc độ truy vấn chậm đi không phải vì máy tính yếu, mà vì nó mất quá nhiều thời gian để “tìm xem dữ liệu nằm ở đâu”.

Table Format ra đời để giải quyết triệt để những vấn đề này bằng cách thêm một lớp Metadata Layer thông minh trên đỉnh các file dữ liệu thô.

2. Phân tích kiến trúc: Delta Lake vs Iceberg vs Hudi

Mặc dù cả ba đều hướng tới mục tiêu xây dựng Lakehouse, nhưng “DNA” của chúng lại rất khác biệt.

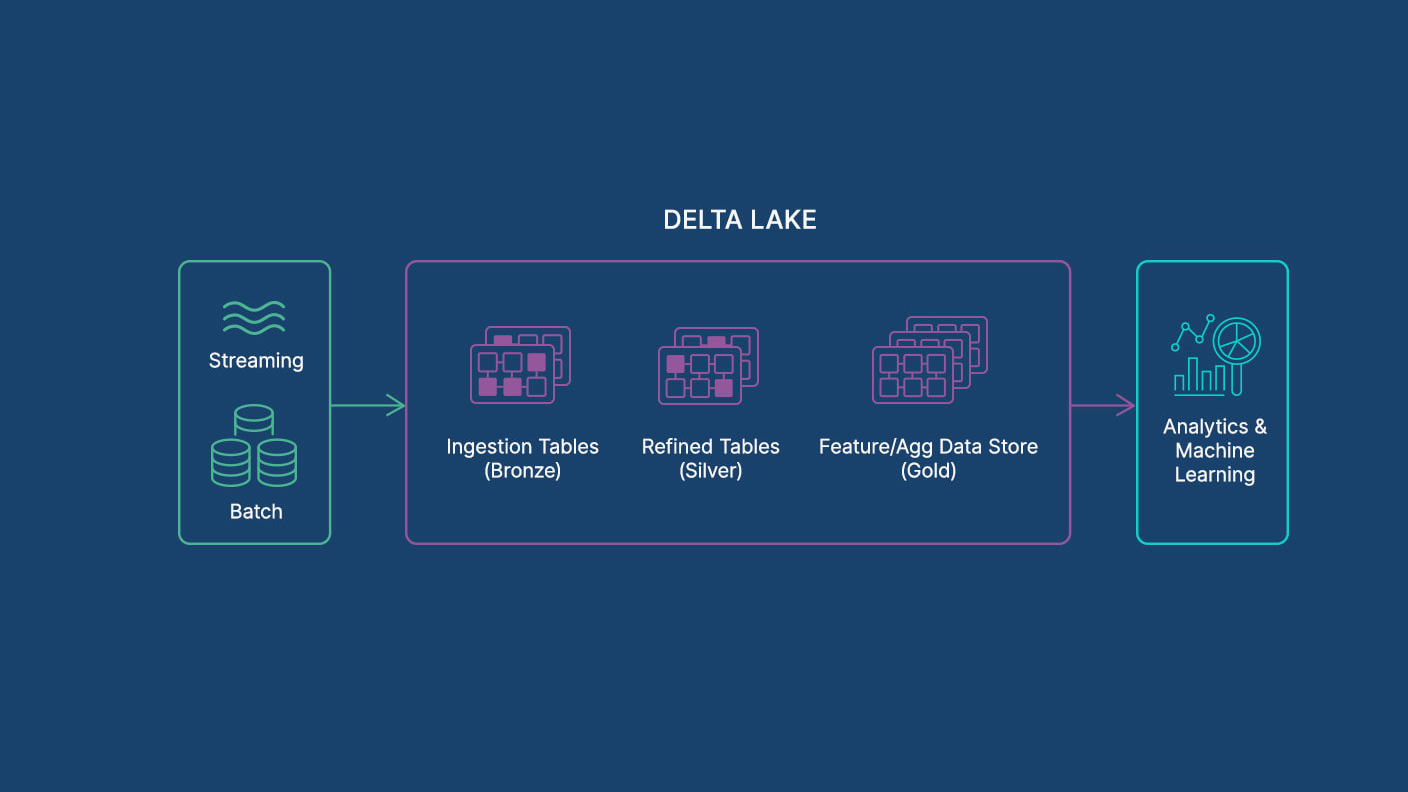

2.1. Delta Lake: Triết lý “Spark-Centric” và sự tối giản

Delta Lake, đứa con cưng của Databricks, sử dụng cơ chế Transaction Log (thường được gọi là Delta Log). Mỗi khi có thay đổi, một file JSON mới sẽ được tạo ra trong thư mục _delta_log để ghi lại lịch sử.

- Ưu điểm kỹ thuật: Nhờ sự tích hợp sâu với Apache Spark, Delta Lake cực kỳ mạnh mẽ trong các tác vụ xử lý hàng loạt (Batch) và luồng (Streaming) đồng thời. Nó hỗ trợ “Optimistic Concurrency Control”, cho phép nhiều người dùng cùng đọc và ghi mà không gây xung đột.

- Cơ chế Checkpoint: Để tránh việc phải đọc hàng nghìn file JSON khi mở một bảng lớn, Delta Lake định kỳ gộp các log này thành một file Checkpoint dạng Parquet, giúp tăng tốc độ tái tạo trạng thái bảng.

2.2. Apache Iceberg: Kiến trúc phân cấp (Hierarchical Metadata)

Iceberg được Netflix thiết kế để thay thế hoàn toàn cấu trúc thư mục của Hive. Khác với Delta, Iceberg không nhìn dữ liệu theo thư mục, nó nhìn dữ liệu theo Snapshots.

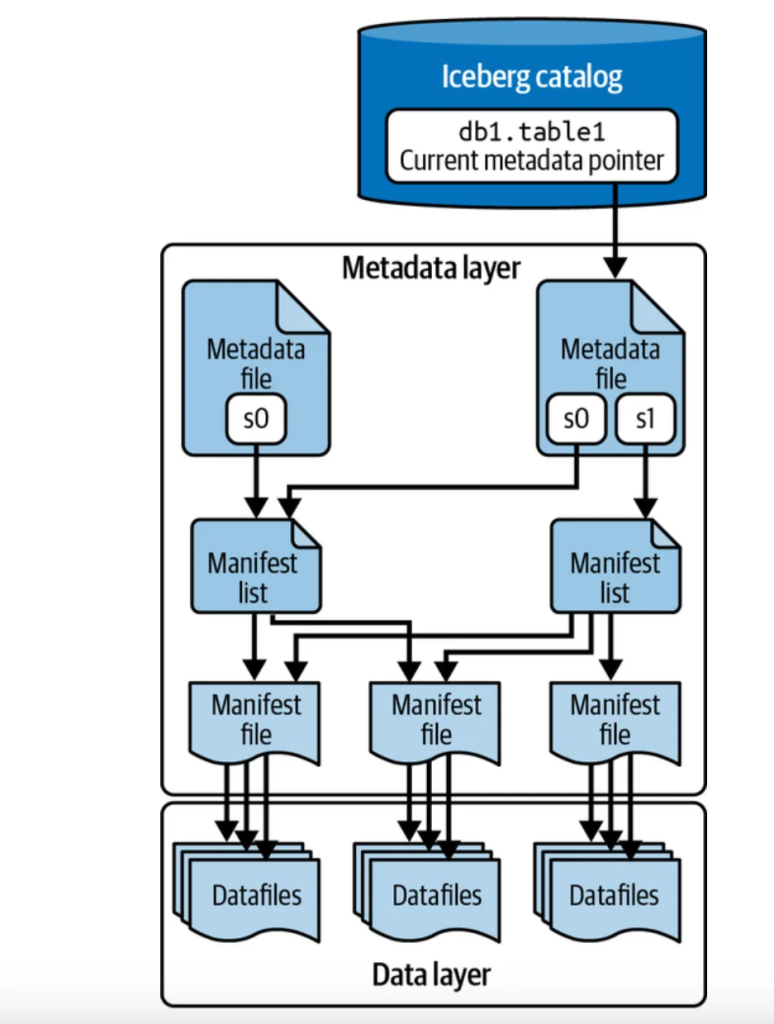

- Metadata Tree: Iceberg lưu trữ metadata theo cấu trúc hình cây: Metadata File -> Manifest List -> Manifest File -> Data Files.

- Sự đột phá: Cấu trúc này cho phép “Fine-grained Partitioning”. Bạn có thể lọc dữ liệu cực nhanh mà không cần chạm vào ổ đĩa nhiều. Đặc biệt, tính năng Hidden Partitioning giúp người dùng không cần phải quan tâm đến việc bảng được phân vùng theo ngày hay giờ khi viết câu lệnh SQL.

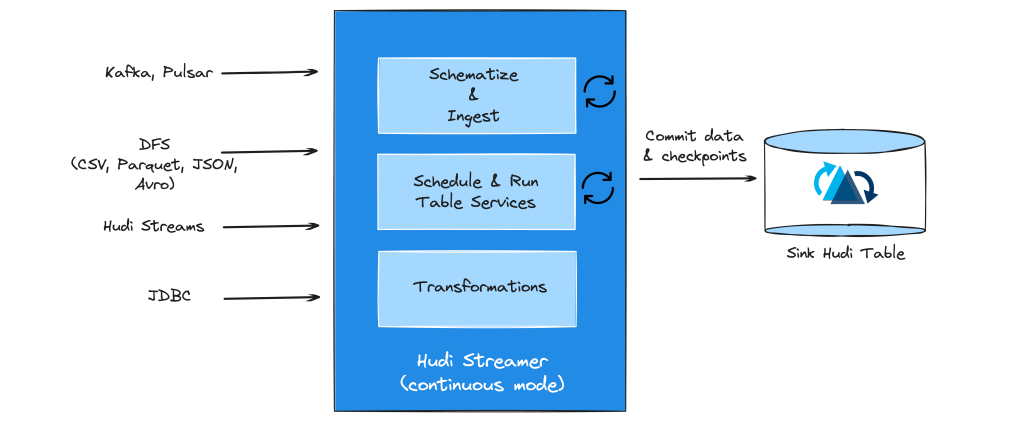

2.3. Apache Hudi: “Vua” của Incremental Processing

Hudi (Hadoop Upserts Deletes and Incrementals) được Uber tạo ra để xử lý các luồng dữ liệu thay đổi liên tục (CDC) từ các cơ sở dữ liệu gốc như MySQL hay Postgres.

- Timeline Service: Hudi duy trì một trục thời gian (Timeline) ghi lại tất cả các hoạt động trên bảng.

- Chỉ mục thông minh (Indexing): Hudi tích hợp sẵn các bộ chỉ mục (Bloom filters, HBase, hoặc Metadata Table) để xác định vị trí của bản ghi cần cập nhật cực nhanh, thay vì phải quét toàn bộ bảng như các format khác.

3. Các Trade-off (Đánh đổi) quan trọng về hiệu suất

Trong công nghệ, không có giải pháp nào hoàn hảo 100%. Lựa chọn giữa Delta Lake vs Iceberg vs Hudi là bài toán đánh đổi giữa Read và Write.

3.1. Copy on Write (CoW) vs Merge on Read (MoR)

Đây là khái niệm cốt lõi khi nói về hiệu suất ghi:

- CoW (Ưu tiên đọc): Mỗi khi có update, hệ thống tạo ra một file dữ liệu mới hoàn chỉnh. Tốc độ đọc rất nhanh vì dữ liệu luôn được “sắp xếp” gọn gàng, nhưng tốc độ ghi sẽ chậm và tốn tài nguyên. Delta Lake chủ yếu đi theo hướng này.

- MoR (Ưu tiên ghi): Khi có update, hệ thống chỉ ghi phần thay đổi vào một file nhỏ (Delta file/Log file). Khi đọc, hệ thống sẽ “trộn” file thô và file log lại. Hudi và Iceberg (v2) hỗ trợ rất mạnh cơ chế này, giúp xử lý các pipeline CDC với độ trễ cực thấp.

3.2. Quản lý File nhỏ (The Small File Problem)

Nếu hệ thống của bạn nạp dữ liệu liên tục mỗi phút, bạn sẽ gặp tình trạng hàng triệu file nhỏ vài KB.

- Delta Lake: Cung cấp tính năng OPTIMIZE để gộp file (Compaction).

- Hudi: Có cơ chế tự động quản lý kích thước file trong quá trình ghi (Clustering), giúp duy trì hiệu suất ổn định mà không cần can thiệp thủ công quá nhiều.

- Iceberg: Cung cấp các API để thực hiện bảo trì bảng, nhưng thường yêu cầu người dùng tự lập lịch các job bảo trì.

4. Khả năng tiến hóa Schema (Schema Evolution)

Một hệ thống Lakehouse thành công phải cho phép Business thay đổi yêu cầu mà không làm hỏng hạ tầng.

- Iceberg dẫn đầu tuyệt đối: Nó hỗ trợ thay đổi cột, đổi tên, xóa cột mà không bao giờ thay đổi ID của cột đó bên dưới. Thậm chí, nó hỗ trợ Partition Evolution – ví dụ: năm nay bạn phân vùng theo tháng, năm sau bạn muốn đổi sang phân vùng theo ngày, Iceberg cho phép bạn làm điều đó mà không cần ghi lại toàn bộ dữ liệu cũ.

- Delta Lake: Rất chặt chẽ với tính năng Schema Enforcement, giúp ngăn chặn dữ liệu rác làm hỏng bảng, nhưng sự linh hoạt trong việc thay đổi cấu trúc phân vùng còn hạn chế hơn Iceberg.

5. Framework lựa chọn thực chiến: Đâu là Table Format dành cho bạn?

Đừng chọn dựa trên sự nổi tiếng của thương hiệu, hãy chọn dựa trên Hệ sinh thái (Ecosystem) và Workload.

Hãy chọn Delta Lake khi:

- Doanh nghiệp của bạn đã “all-in” vào Databricks.

- Đội ngũ kỹ thuật mạnh về Apache Spark và muốn một giải pháp ít cấu hình nhất (Out-of-the-box).

- Ưu tiên sự ổn định cho các bài toán Business Intelligence (BI) và Reporting truyền thống.

Hãy chọn Apache Iceberg khi:

- Hệ thống của bạn là Multi-engine: Bạn dùng Flink để xử lý, Trino để truy vấn ad-hoc, và Spark để ETL.

- Bạn quản lý các bảng dữ liệu siêu khổng lồ và cần tính năng phân vùng linh hoạt để tối ưu chi phí Cloud.

- Bạn muốn một định dạng hoàn toàn độc lập, không bị ràng buộc bởi bất kỳ nhà cung cấp dịch vụ nào (Vendor Lock-in).

Hãy chọn Apache Hudi khi:

- Yêu cầu bắt buộc là Near Real-time: Bạn cần dữ liệu xuất hiện trong Lakehouse chỉ vài phút sau khi có thay đổi ở Database nguồn.

- Bạn có lượng lớn các thao tác Upsert/Delete liên tục.

- Đội ngũ của bạn có kinh nghiệm vận hành dày dặn, sẵn sàng tinh chỉnh các thông số kỹ thuật phức tạp để đổi lấy hiệu suất ghi tối ưu.

6. Các sai lầm “đốt tiền” khi triển khai Table Format

- Quên lệnh VACUUM/Expire Snapshots: Cả ba format đều giữ lại các phiên bản cũ của dữ liệu để hỗ trợ Time Travel. Nếu bạn không định kỳ xóa các bản cũ này, hóa đơn tiền lưu trữ S3/GCS của bạn sẽ tăng vọt sau vài tháng.

- Không chú trọng vào Data Governance: Table Format chỉ là tầng vật lý. Nếu bạn không kết hợp với các công cụ quản trị như Unity Catalog hay Apache Ranger, Lakehouse của bạn sẽ sớm trở thành một “kho chứa” hỗn độn về quyền truy cập.

- Bỏ qua việc nén dữ liệu (Compaction): Việc chỉ ghi dữ liệu mà không gộp file sẽ khiến tốc độ truy vấn chậm dần đều. Hãy đảm bảo quy trình bảo trì bảng (Table Maintenance) là một phần của quy trình vận hành chính thức.

7. Kết luận và Tương lai của Table Format

Cuộc chiến giữa Delta Lake vs Iceberg vs Hudi đang tiến tới giai đoạn Hội tụ (Convergence).

- Databricks đã tung ra Delta UniForm, cho phép dữ liệu ghi dưới dạng Delta nhưng có thể được đọc như Iceberg.

- Tabular (công ty đứng sau Iceberg) đã bị Databricks thâu tóm, báo hiệu một tương lai nơi các rào cản giữa các định dạng này sẽ dần biến mất.

Lời khuyên cuối cùng: Thay vì quá sa đà vào việc so sánh tính năng, hãy tập trung vào việc xây dựng một Data Strategy rõ ràng. Table Format chỉ là công cụ, mục tiêu cuối cùng vẫn là mang lại giá trị từ dữ liệu cho doanh nghiệp một cách nhanh nhất và rẻ nhất.

FAQ: Giải đáp thắc mắc về Table Format

1. Tôi có thể chuyển đổi giữa các Table Format không?

Có, hiện nay có nhiều công cụ hỗ trợ chuyển đổi metadata mà không cần ghi lại toàn bộ dữ liệu (In-place migration). Tuy nhiên, quy trình này vẫn cần được kiểm thử kỹ lưỡng.

2. Table Format nào hỗ trợ tốt nhất cho SQL?

Iceberg và Delta Lake hiện đang dẫn đầu về khả năng tương thích SQL thông qua các engine như Trino, Presto và Spark SQL.

3. Liệu có định dạng nào sẽ bị khai tử không?

Cả ba hiện đều có cộng đồng mã nguồn mở cực kỳ mạnh mẽ và được các ông lớn công nghệ (AWS, Google, Microsoft) hỗ trợ. Việc một định dạng bị biến mất trong 3-5 năm tới là điều khó xảy ra.

INDA Academy tự hào là đơn vị tiên phong trong việc đào tạo phân tích dữ liệu và AI chuyên sâu, đặc biệt cho khối ngành Ngân hàng – Tài chính – Bảo hiểm tại Việt Nam. Sau hơn 12 năm “thực chiến” cùng những dòng chảy dữ liệu khổng lồ, chúng tôi đã xây dựng nên một hệ sinh thái đào tạo toàn diện, giúp hàng nghìn học viên chuyển mình từ người mới bắt đầu trở thành những chuyên gia lành nghề, sẵn sàng đáp ứng tiêu chuẩn khắt khe của các doanh nghiệp lớn.

Điểm khác biệt lớn nhất tại INDA chính là triết lý đào tạo dựa trên các dự án thực tế (Project-based) và lộ trình cá nhân hóa nhờ ứng dụng AI. Chúng tôi không chỉ dạy bạn cách sử dụng công cụ, mà còn truyền tải tư duy khai phá giá trị từ dữ liệu để đưa ra quyết định kinh doanh chính xác.

Tìm hiểu thêm về các khóa học TẠI ĐÂY:

Lộ trình đào tạo Data Engineer

Lộ trình đào tạo Data Analyst

Lộ trình đào tạo Tester

Khóa học Data Engineer nâng cao – Thực chiến 5 dự án doanh nghiệp

Khóa học Data Analyst nâng cao – Thực chiến 5 dự án doanh nghiệp