Hãy tưởng tượng bạn vừa hoàn thiện một thuật toán tính toán chỉ số sức khỏe khách hàng cực kỳ thông minh. Nhưng vấn đề là: thuật toán này chỉ bắt đầu hoạt động từ… sáng nay. Trong khi đó, ban giám đốc lại muốn nhìn thấy biểu đồ so sánh của cả sáu tháng vừa qua để đưa ra quyết định chiến lược cho quý mới. Hoặc một tình huống ngặt nghèo hơn: bạn phát hiện ra một lỗi logic nhỏ trong hệ thống đã âm thầm làm sai lệch con số doanh thu suốt cả tuần lễ mà không ai hay biết.

Lúc này, bạn không thể nói “giá như”. Bạn cần phải hành động. Data Backfill chính là quy trình “ngược dòng thời gian” để nạp lại, tính toán lại và làm sạch những gì đã trôi qua. Đây không chỉ là một kỹ thuật cứu nguy khi hệ thống gặp sự cố, mà còn là một tư duy kiến trúc quan trọng giúp dòng chảy dữ liệu của doanh nghiệp luôn giữ được tính nhất quán và chính xác tuyệt đối, bất kể những biến động của lịch sử.

Mục lục

I. Vì sao pipeline đôi khi phải “nhai” lại dữ liệu cũ?

Không một hệ thống dữ liệu nào hoàn hảo 100%. Data Backfill sinh ra để giải quyết những “vết nứt” phát sinh trong quá trình vận hành thực tế. Có bốn tình huống điển hình mà bất kỳ Data Engineer nào cũng sẽ phải đối mặt:

1. Sự cố hệ thống và hạ tầng: Đây là lý do phổ biến nhất. Một ngày nọ, công cụ điều phối (Orchestrator) như Airflow bị lỗi, hoặc cụm máy chủ xử lý dữ liệu bị quá tải và sập. Kết quả là pipeline không chạy trong 3 ngày liên tiếp. Khi hệ thống hoạt động trở lại, bạn không thể bỏ qua 3 ngày đó. Bạn cần “backfill” để lấp đầy khoảng trống dữ liệu trong kho.

2. Cập nhật logic kinh doanh: Hãy tưởng tượng công ty bạn thay đổi công thức tính “Lợi nhuận ròng”. Trước đây công thức là Doanh thu – Giá vốn, nhưng giờ sếp muốn trừ thêm Chi phí Marketing. Để các biểu đồ so sánh theo năm (Year-over-Year) không bị khập khiễng, bạn buộc phải chạy lại toàn bộ dữ liệu của 1-2 năm trước theo công thức mới.

3. Nguồn dữ liệu bị sai lệch: Đôi khi lỗi không nằm ở bạn mà nằm ở phía đối tác cung cấp dữ liệu. Khi hệ thống nguồn (Upstream) phát hiện bug và sửa lại dữ liệu của tháng trước, họ sẽ yêu cầu bạn nạp lại (re-ingest) để đảm bảo tính chính xác cho các báo cáo phân tích hạ nguồn.

4. Dữ liệu đến muộn (Late-arriving data): Trong các hệ thống Tracking sự kiện, người dùng có thể ngoại tuyến cả ngày rồi mới đồng bộ dữ liệu vào đêm muộn. Khi pipeline hằng ngày đã chốt sổ, những dữ liệu “đến muộn” này cần được xử lý bổ sung thông qua một cơ chế backfill định kỳ để hoàn thiện bức tranh dữ liệu.

II. Bản chất của quá trình Data Backfill

Hiểu một cách đơn giản, Data Backfill là quá trình xử lý lại dữ liệu lịch sử để bổ sung hoặc sửa đổi thông tin trong hệ thống analytics. Nó không đơn thuần là việc nhấn nút “Run” một lần nữa. Đó là một chiến dịch có tính toán nhằm tái cấu trúc lại một phần quá khứ của dữ liệu mà không làm hỏng trạng thái hiện tại của hệ thống.

Ví dụ, trong một bảng doanh thu theo ngày, nếu ngày 15/02 bị mất dữ liệu do lỗi cáp quang biển, việc backfill chính là tạo ra một “phiên làm việc” (session) riêng biệt, chỉ định phạm vi từ ngày 15/02 đến 15/02, và bắt hệ thống thực hiện lại toàn bộ các bước: Trích xuất (Extract) -> Biến đổi (Transform) -> Nạp (Load).

III. Khi nào hoạt động Backfill trở nên bắt buộc?

Nhiều người nghĩ backfill là một việc “cực chẳng đã”, nhưng thực tế đây là một phần không thể thiếu của vòng đời dữ liệu chuyên nghiệp.

Khi xây dựng một hệ thống Analytics mới hoàn toàn, bạn không thể bắt đầu từ con số 0 của ngày hôm nay. Các bộ phận kinh doanh luôn cần dữ liệu lịch sử để thấy được xu hướng. Quá trình load 5 năm dữ liệu cũ vào kho dữ liệu mới chính là một đợt Initial Backfill quy mô lớn.

Ngoài ra, trong kỷ nguyên AI và Machine Learning, việc huấn luyện mô hình (Model Training) đòi hỏi dữ liệu quá khứ phải cực kỳ sạch và chuẩn xác. Nếu logic trích xuất tính năng (Feature Engineering) thay đổi, kỹ sư dữ liệu phải thực hiện backfill trên toàn bộ tập dữ liệu huấn luyện để đảm bảo mô hình không bị “lệch” (bias) do dữ liệu cũ và mới không đồng nhất.

IV. Cơ chế vận hành: Pipeline hoạt động như thế nào khi Backfill?

Về mặt kỹ thuật, một pipeline được thiết kế tốt cho backfill thường hoạt động theo nguyên tắc tham số hóa (Parameterization). Thay vì viết cứng (hard-code) thời gian lấy dữ liệu là “hôm nay”, pipeline sẽ nhận vào các tham số như start_date và end_date.

Quy trình thực thi thường diễn ra theo 5 bước:

- Xác định phạm vi: Khoanh vùng chính xác thời gian dữ liệu bị lỗi hoặc thiếu.

- Trích xuất lại: Quay lại lớp lưu trữ thô (Raw Layer) để lấy dữ liệu gốc của khoảng thời gian đó.

- Thực thi logic: Chạy các mã lệnh biến đổi (code Transform) trên tập dữ liệu cũ.

- Ghi đè/Cập nhật: Nạp dữ liệu đã xử lý vào kho dữ liệu. Bước này yêu cầu hệ thống phải có tính lũy đẳng (Idempotency) để tránh việc nạp chồng dữ liệu cũ.

- Hậu kiểm: So sánh tổng số dòng (row count) và các chỉ số chính (metrics) trước và sau khi backfill để đảm bảo không có sai sót mới phát sinh.

V. Các chiến lược triển khai Data Backfill hiệu quả

Tùy vào kiến trúc hệ thống, bạn có thể chọn một trong các chiến lược sau để tối ưu hóa thời gian và tài nguyên:

1. Xử lý lại từ dữ liệu thô (Reprocess từ Raw Data)

Đây là cách an toàn và triệt để nhất. Trong kiến trúc hiện đại, dữ liệu gốc thường được lưu giữ vĩnh viễn trong Data Lake (S3, GCS). Khi cần backfill, chúng ta bỏ qua các bảng Staging hiện tại và chạy lại toàn bộ logic từ dữ liệu gốc. Cách này đảm bảo tính chính xác tuyệt đối nhưng sẽ tiêu tốn khá nhiều tài nguyên tính toán (compute).

2. Chiến lược phân vùng (Partition-based Backfill)

Nếu kho dữ liệu của bạn được phân vùng theo thời gian (ví dụ: mỗi ngày là một phân vùng), việc backfill sẽ trở nên rất gọn gàng. Bạn chỉ cần thực hiện lệnh “Overwrite Partition” cho đúng ngày bị lỗi. Hệ thống sẽ xóa sạch dữ liệu cũ của ngày đó và thay thế bằng dữ liệu mới trong một thao tác duy nhất, giúp giảm thiểu rủi ro dữ liệu bị “nửa cũ nửa mới”.

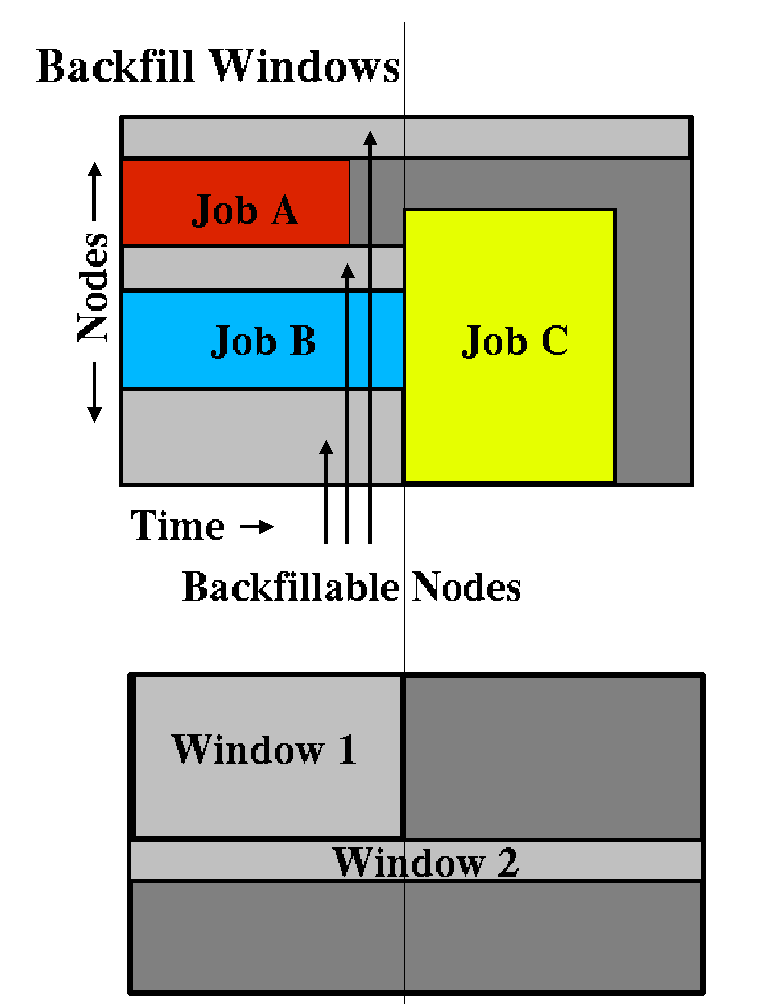

3. Cửa sổ quay lui (Window-based Backfill)

Nhiều pipeline được thiết kế để luôn luôn reprocess dữ liệu của “N ngày gần nhất” mỗi khi chạy. Ví dụ, mỗi đêm pipeline sẽ xử lý dữ liệu của 7 ngày qua. Đây là một dạng backfill tự động thu nhỏ, cực kỳ hữu ích để xử lý những thay đổi nhỏ hoặc dữ liệu đến muộn mà không cần kỹ sư phải can thiệp thủ công.

VI. Những rủi ro “chết người” khi chạy Backfill

Đừng bao giờ coi thường một lệnh backfill, đặc biệt là trên các bảng dữ liệu lớn. Nếu không cẩn thận, bạn có thể gây ra những hậu quả nghiêm trọng hơn cả lỗi ban đầu.

Rủi ro lớn nhất là trùng lặp dữ liệu (Duplicate Data). Nếu pipeline của bạn không có cơ chế kiểm tra bản ghi đã tồn tại (Idempotency), việc chạy lại sẽ khiến số lượng dòng tăng gấp đôi. Doanh thu 1 tỷ sẽ biến thành 2 tỷ trên Dashboard, gây hoang mang cho toàn bộ ban lãnh đạo.

Thứ hai là áp lực lên tài nguyên hệ thống. Backfill 3 năm dữ liệu cùng một lúc có thể chiếm dụng toàn bộ tài nguyên của cụm Spark hoặc kho dữ liệu BigQuery, khiến các pipeline quan trọng hàng ngày bị đình trệ (delay). Ngoài ra, việc thay đổi số liệu lịch sử đột ngột có thể khiến các bộ phận kinh doanh nghi ngờ tính xác thực của hệ thống dữ liệu (“Tại sao doanh thu tháng trước hôm nay lại khác hôm qua?”).

VII. Các nguyên tắc vàng để thiết kế Backfill Pipeline

Để hoạt động backfill diễn ra êm đẹp, một kỹ sư dữ liệu cần tuân thủ các nguyên tắc thiết kế sau:

- Tính lũy đẳng (Idempotency) là bắt buộc: Pipeline phải được thiết kế sao cho việc chạy lại nhiều lần cho cùng một khoảng thời gian luôn cho ra một kết quả duy nhất. Sử dụng lệnh MERGE hoặc INSERT OVERWRITE thay vì INSERT INTO đơn thuần.

- Lưu giữ dữ liệu thô (Raw Data) vĩnh viễn: Đừng bao giờ xóa dữ liệu gốc sau khi xử lý. Raw data chính là “bảo hiểm” duy nhất giúp bạn rebuild lại toàn bộ hệ thống khi có sự cố.

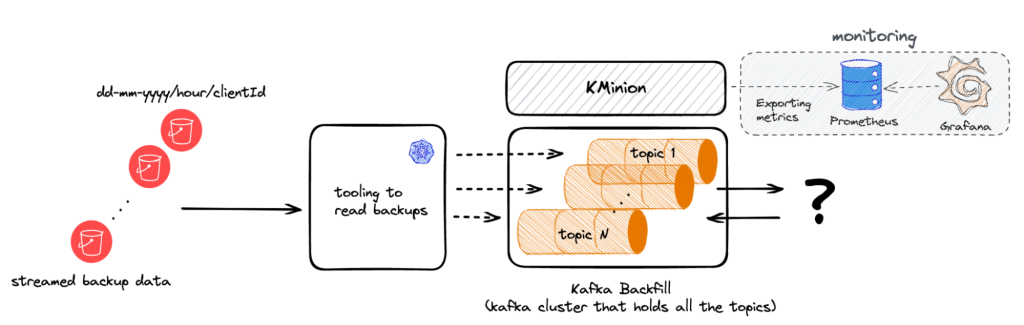

- Tách biệt luồng chạy: Không bao giờ chạy các job backfill lớn chung với luồng dữ liệu production hàng ngày. Hãy tách chúng ra một luồng riêng (Job/DAG riêng) để dễ dàng theo dõi và giới hạn tài nguyên.

- Theo dõi và cảnh báo (Monitoring): Thiết lập các chốt kiểm tra chất lượng dữ liệu (Data Quality Checks) ngay sau khi backfill xong để phát hiện kịp thời các bất thường về số lượng dòng hoặc giá trị metrics.

VIII. Công cụ hỗ trợ Backfill chuyên nghiệp

Hiện nay, hầu hết các công cụ ETL/ELT hiện đại đều hỗ trợ backfill mạnh mẽ:

- Apache Airflow: Cung cấp lệnh airflow dags backfill cho phép bạn chỉ định rõ khoảng thời gian cần chạy lại. Airflow sẽ tự động quản lý các phụ thuộc (dependencies) giữa các tác vụ.

- dbt (Data Build Tool): Với lệnh dbt run –select my_model –full-refresh hoặc sử dụng các biến vars, bạn có thể dễ dàng re-materialize các bảng dữ liệu lịch sử.

- Apache Spark: Cho phép đọc và ghi dữ liệu theo từng phân vùng (partition), hỗ trợ đắc lực cho việc xử lý song song khối lượng dữ liệu lịch sử khổng lồ.

IX. Kết luận

Trong môi trường dữ liệu thực tế, sai số và sự cố là điều không thể tránh khỏi. Data Backfill không phải là một “lỗi” của hệ thống, mà là một khả năng sinh tồn tất yếu. Một kỹ sư dữ liệu giỏi không phải là người không bao giờ để xảy ra lỗi, mà là người thiết kế được những hệ thống có khả năng sửa sai một cách tự tin và an toàn.

Bằng cách nắm vững các chiến lược backfill, kết hợp với tư duy thiết kế Idempotent và cấu trúc phân vùng hợp lý, bạn sẽ giữ cho dòng sông dữ liệu của doanh nghiệp luôn trong xanh và đáng tin cậy, bất kể những biến động của quá khứ.

INDA Academy tự hào là đơn vị tiên phong trong việc đào tạo phân tích dữ liệu và AI chuyên sâu, đặc biệt cho khối ngành Ngân hàng – Tài chính – Bảo hiểm tại Việt Nam. Sau hơn 12 năm “thực chiến” cùng những dòng chảy dữ liệu khổng lồ, chúng tôi đã xây dựng nên một hệ sinh thái đào tạo toàn diện, giúp hàng nghìn học viên chuyển mình từ người mới bắt đầu trở thành những chuyên gia lành nghề, sẵn sàng đáp ứng tiêu chuẩn khắt khe của các doanh nghiệp lớn.

Điểm khác biệt lớn nhất tại INDA chính là triết lý đào tạo dựa trên các dự án thực tế (Project-based) và lộ trình cá nhân hóa nhờ ứng dụng AI. Chúng tôi không chỉ dạy bạn cách sử dụng công cụ, mà còn truyền tải tư duy khai phá giá trị từ dữ liệu để đưa ra quyết định kinh doanh chính xác.

Tìm hiểu thêm về các khóa học TẠI ĐÂY:

Lộ trình đào tạo Data Engineer

Lộ trình đào tạo Data Analyst

Lộ trình đào tạo Tester

Khóa học Data Engineer nâng cao – Thực chiến 5 dự án doanh nghiệp

Khóa học Data Analyst nâng cao – Thực chiến 5 dự án doanh nghiệp